Estafas digitales: el hackeo de las emociones

Marzo 6, 2026

5 errores de seguridad que facilitan el robo de cuentas

Marzo 8, 2026Descubre cómo funcionan los ataques a través de Hugging Face, los riesgos asociados a la deserialización de modelos y las estrategias de gobernanza necesarias para proteger tu empresa.

05 Mar 2026

•

,

8 min. read

Hugging Face es la principal plataforma global para la colaboración y el alojamiento de modelos de Inteligencia Artificial (IA) y machine learning. Valuada en 4.5 mil millones de dólares, y frecuentemente descrita como el “GitHub de la IA”, funciona como un ecosistema centralizado donde desarrolladores, investigadores y empresas comparten, prueban e implementan modelos de código abierto (open source), conjuntos de datos (datasets) y aplicaciones de demostración.

En el escenario tecnológico actual, la plataforma se ha consolidado como la columna vertebral de la transformación digital, permitiendo que empresas de todos los tamaños accedan a tecnologías de vanguardia como el Procesamiento de Lenguaje Natural (PLN) y la Visión Computacional sin necesidad de contar con infraestructuras propietarias multimillonarias. Sin embargo, esta democratización ha traído un nuevo desafío crítico para los profesionales de ciberseguridad: la seguridad de la cadena de suministro de IA (AI Supply Chain).

Aunque impulsa gran parte de la innovación, Hugging Face también se ha convertido en un vector estratégico para cibercriminales. Mediante técnicas sofisticadas de envenenamiento de modelos y ejecución de código malicioso, actores maliciosos aprovechan la confianza depositada en modelos open source para infiltrarse en infraestructuras corporativas. Entender qué es Hugging Face y cómo utilizarla de forma segura ya no es solo una ventaja competitiva, sino una necesidad para la supervivencia digital.

¿Cómo funciona Hugging Face?

Para entender cómo se utiliza Hugging Face en el día a día corporativo, imagina una gran biblioteca de “piezas de software inteligentes” listas para integrarse en cualquier sistema. La plataforma opera a través de una arquitectura basada en tres pilares interconectados que permiten desde la investigación académica hasta la producción a escala industrial:

1. El Model Hub (Hub de Modelos)

Es el corazón de la plataforma. Como un repositorio centralizado, aloja modelos preentrenados desarrollados por gigantes tecnológicos como Meta, Google y Microsoft. Su funcionamiento es sencillo: un desarrollador no necesita entrenar una IA desde cero —un proceso que podría costar millones de dólares en capacidad de cómputo—; simplemente selecciona un modelo base y lo adapta a su necesidad específica mediante fine-tuning (ajuste fino).

2. La biblioteca Transformers

La gran innovación de Hugging Face fue la estandarización. A través de la biblioteca Transformers, la plataforma proporciona el código necesario para que distintos modelos “hablen el mismo idioma”. Esto permite que una empresa integre una IA de traducción, un clasificador de sentimientos o un generador de imágenes utilizando la misma estructura de programación en Python, lo que reduce drásticamente la barrera técnica de entrada.

3. Datasets y Spaces: el laboratorio de pruebas

- Datasets: Son los conjuntos de datos masivos utilizados para entrenar los modelos. La plataforma ofrece bibliotecas listas para que las IAs sean entrenadas de acuerdo con necesidades o nichos específicos (por ejemplo, terminología jurídica o diagnósticos médicos).

- Spaces: Funcionan como una vitrina dinámica. Es el lugar donde las empresas alojan demostraciones funcionales de sus modelos, permitiendo que los usuarios finales prueben la tecnología directamente desde el navegador, sin necesidad de descargar un solo archivo.

¿Cómo aprovecha el cibercrimen la Hugging Face?

La misma facilidad que permite a una empresa innovar en cuestión de horas también es utilizada por cibercriminales para comprometer infraestructuras completas. En 2026, Hugging Face se convirtió en un punto focal para ataques a la cadena de suministro de software, donde o alvo já não es el código fuente, sino el propio “cerebro” de la aplicación: el modelo de IA.

Los cibercriminales utilizan la plataforma principalmente a través de cuatro vectores críticos:

- Inyección de malware a través de modelos (Model Poisoning): Archivos tradicionales (como .pth o .bin) pueden permitir la ejecución de scripts al ser cargados. El cibercriminal publica un modelo de alto rendimiento que contiene una puerta trasera silenciosa, garantizando control total sobre el servidor objetivo.

- Secuestro de nombres (Typosquatting): Consiste en registrar perfiles con nombres casi idénticos a los de empresas reconocidas. Un simple error tipográfico de un ingeniero puede resultar en la descarga de un modelo malicioso diseñado para robar datos sensibles.

- IA como motor ofensivo: Uso de modelos disponibles en la plataforma para automatizar campañas de phishing hiperpersonalizado o generar malwares polimórficos capaces de evadir soluciones antivirus tradicionales.

- Filtración de credenciales: Uso de bots que recorren la plataforma 24/7 buscando claves de API, contraseñas y tokens que desarrolladores hayan dejado accidentalmente expuestos en los repositorios.

Cuando la confianza se convierte en vulnerabilidad

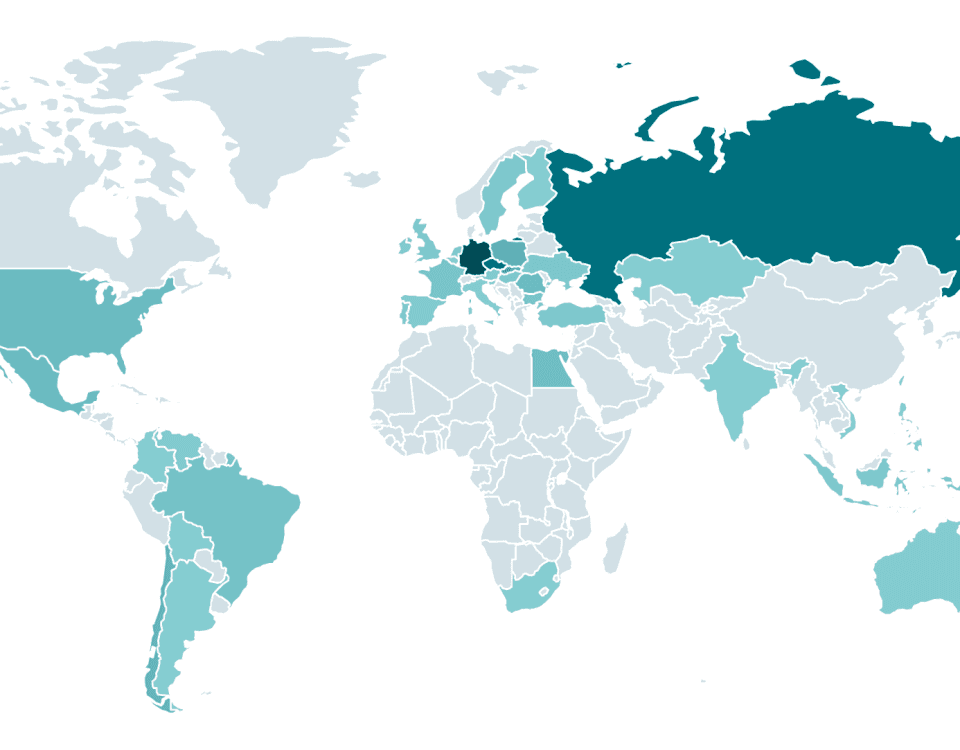

El riesgo asociado al uso de repositorios abiertos no es teórico. Incidentes recientes demuestran cómo ciberdelincuentes han explotado la plataforma para comprometer infraestructuras a nivel global:

El incidente de los archivos maliciosos (2024-2025)

Según lo documentado por Forbes y la firma de ciberseguridad JFrog, se identificaron más de 100 modelos que contenían payloads capaces de ejecutar código de manera remota (Remote Code Execution, RCE) dentro del repositorio. La respuesta de Hugging Face incluyó la implementación de un sistema nativo de Malware Scan y la promoción agresiva del formato Safetensors, que aísla los datos y evita cualquier lógica ejecutable dentro de los archivos.

La filtración de 1.500 tokens (caso de Lasso Security, 2024)

La investigación realizada por Lasso Security confirmó que varios API tokens expuestos permitían acceso de escritura a repositorios pertenecientes a organizaciones como Meta y Google. El impacto real radicó en la posible modificación no autorizada de modelos fundamentales, lo que habría comprometido la integridad de miles de aplicaciones derivadas (downstream attack).

Distribución de malware para Android (caso TrustBastion)

Especialistas en ciberseguridad alertaron que ciberdelincuentes comenzaron a utilizar Hugging Face como plataforma de distribución para malware dirigido a smartphones y tabletas. A través de un instalador denominado TrustBastion, los atacantes difundieron un malware capaz de asumir el control total de dispositivos Android comprometidos, demostrando que el riesgo asociado a la plataforma puede extenderse incluso hasta el usuario final.

El desafío de la moderación y la ética

Investigaciones revelaron que, a pesar de su posicionamiento ético, la plataforma ha sido utilizada para alojar y distribuir modelos de deepfakes pornográficos no consensuados e imágenes no autorizadas de celebridades. Este caso destaca la dificultad de moderar contenido a gran escala y el riesgo de que una empresa termine asociando su marca a una infraestructura que hospeda material ilegal o altamente sensible.

¿Cómo utilizar Hugging Face de forma segura?

La empresa es consciente de estos desafíos y ha implementado capas estrictas de protección. De acuerdo con el comunicado oficial de seguridad de Hugging Face, la plataforma ahora incorpora:

- Malware Scanning: un sistema de escaneo automático que busca firmas de malware en todos los archivos cargados.

- Safetensors: un formato de archivo innovador que almacena únicamente los pesos del modelo, evitando la ejecución de código. Es fundamental para reemplazar el formato Pickle, considerado de alto riesgo.

- Secret Scanning: herramientas que detectan automáticamente si un desarrollador intenta subir accidentalmente claves de API o contraseñas.

Para evitar que la innovación se convierta en vulnerabilidad, las empresas que utilizan la plataforma también deben adoptar un enfoque de Zero Trust (Confianza Cero) al integrar modelos provenientes de Hugging Face. En 2026, la seguridad en IA exige protocolos que van más allá del antivirus tradicional.

1. Migración obligatoria al formato Safetensors

La medida de seguridad más eficaz es abandonar el uso de modelos en los formatos .pth, .bin o .pickle. Hugging Face desarrolló y promueve Safetensors, un formato de archivo que almacena únicamente los pesos matemáticos del modelo y que no permite la inclusión de scripts ejecutables.

Regla de oro: configura tus sistemas para bloquear la descarga de cualquier archivo que no esté estructurado en formato Safetensors.

2. Ambientes aislados (Sandboxing) y verificación de hash

Nunca ejecutes un modelo nuevo directamente dentro de tu red principal.

- Sandbox: prueba el modelo en un entorno aislado para observar su comportamiento, especialmente si intenta establecer conexiones con direcciones IP sospechosas.

- Checksum: valida la integridad del archivo comparando el hash del modelo descargado con el hash oficial publicado en el repositorio, lo que ayuda a prevenir ataques de interceptación (Man‑in‑the‑Middle).

3. Secret Scanning y DLP

Utiliza herramientas de Data Loss Prevention (DLP) y Secret Scanning para asegurarte de que tus desarrolladores no carguen accidentalmente claves de acceso a la nube o datos sensibles de clientes al contribuir con la plataforma.

Los modelos de IA también necesitan auditoría

Hugging Face es, indiscutiblemente, una de las principales fuerzas impulsoras de la Inteligencia Artificial moderna. Ofrece el atajo necesario para acelerar la transformación digital, pero, como cualquier infraestructura crítica, requiere vigilancia constante.

Para las empresas que buscan liderazgo en 2026, el secreto no es evitar la plataforma, sino profesionalizar su uso. Al tratar los modelos de IA como activos de software sujetos a auditorías de seguridad rigurosas, las organizaciones pueden extraer el máximo valor de la tecnología sin comprometer su integridad digital.

El futuro de la ciberseguridad es híbrido: defender la red humana y, al mismo tiempo, proteger los algoritmos que hoy la sostienen.

¡Para todos nuestros lectores!

Aprovechen esta oportunidad de obtener un trial gratuito de 30 días para Google Workspace, la mejor solución para tu empresa. Disfruta de todas sus funcionalidades, como correo electrónico personalizado, almacenamiento en la nube y herramientas de colaboración.